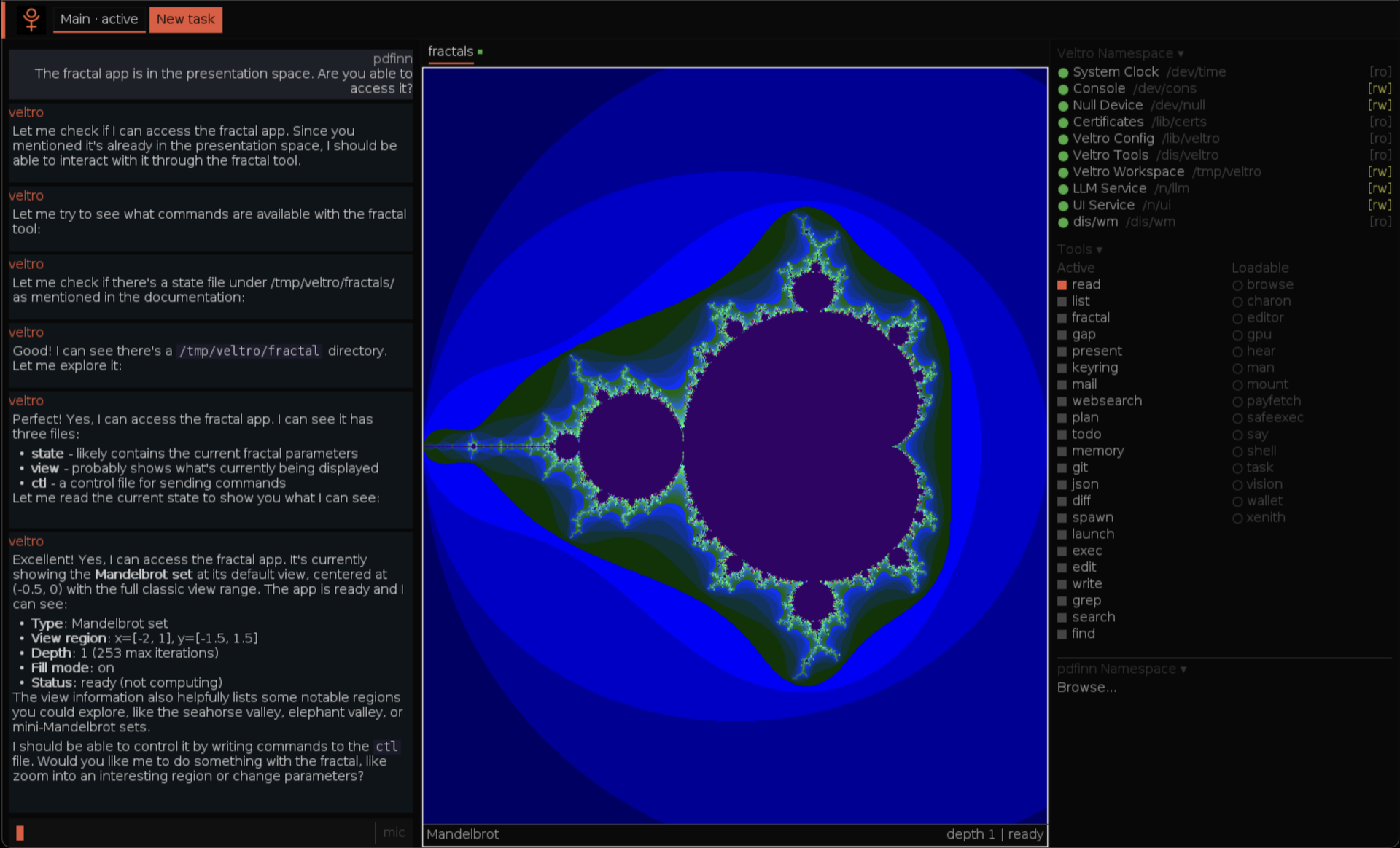

实际运行效果

你与你的智能体,并肩工作。

Veltro 运行应用、组合工具、代你行动—一切都在你控制的命名空间内。它看到的你都看得到,它没有触碰任何你未授予的东西。

问题所在

AI 智能体非常强大。

这正是问题所在。

一个能读取文件、调用 API、派生子进程的 AI 智能体极其有用,但当它与你共享操作系统、凭据和网络访问权时,也极其危险。

今天的答案是各种护栏:外挂的沙箱、权限弹窗、你希望能扛住攻击的策略层。智能体在你的世界里运行,而你只能信任那个笼子。历史告诉我们这并不明智。

InferNode 彻底反转了这个模型。

每个智能体都拥有自己的命名空间—一个仅由你显式挂载的资源构成的世界视图。没有笼子,因为根本没有需要关进笼子里的东西。智能体无法访问你的凭据、邮件或 SSH 密钥,因为在它的命名空间里,这些东西根本不存在。

这改变了一切。一个可证明被封闭的智能体,才是你可以放心赋予真正自主权的智能体。更多自主权意味着更高的生产力。这正是关键所在:对于人与 AI 的协作团队,安全不是约束,而是让协作得以成立的根基。

安全

每个 AI 智能体都运行在自己隔离的命名空间中,只能看到你显式授予的资源。这不是一层策略—这就是操作系统本身的工作方式,并已通过形式化验证。

自主可控

由你决定数据存放在哪里、计算运行在何处。云端、边缘、本地,或三者并用。没有任何厂商替你做这个决定。

可组合

每一种资源—GPU、LLM、数据库、传感器—都以文件的形式呈现。一条命令就能把任意东西接到任意地方,跨越任何设备。

开放

MIT 许可。阅读源码、修改、部署、出售,均无限制。没有贡献者协议,没有许可证反水,没有任何附加条件。

基于能力的安全模型

未授予的资源,

根本不存在。

今天,大多数智能体框架只给你两种选择。要么把智能体跑在你自己的机器上—连同你的凭据、网络和数据—然后祈祷护栏能扛住;要么把一切交给某个云平台,通过把数据搬到别人的电脑上来实现隔离。前者过于信任智能体,后者过于信任云。

InferNode 的做法不同。每个智能体都拥有自己的命名空间—一个仅由你显式共享的资源构成的世界视图。试图访问未被授予的东西?它不会报错。它根本不存在。没有攻击面,因为压根没有"面"可言。

这不是空口承诺。隔离模型已经在三种独立工具中经过形式化验证—TLA+、SPIN 与 CBMC:11 条不变量在 1930 万个状态(穷举)中得到证明,扩展运行覆盖 31.7 亿个状态,加上 113 条 CBMC 断言—零违规。每次推送都会在 CI 中自动重新验证。

正因为智能体被可证明地封闭,你才能放心给它更多自由—更多工具、更多数据、更多自主权—而不必承担更多风险。安全的智能体才是高效的智能体。

查看完整验证报告 →抗量子加密

实验性InferNode 已经初步实现了 ML-KEM(FIPS 203)与 ML-DSA(FIPS 204)—这是 NIST 标准化的、基于格的算法,也是业界正在迁移的对象。NIST Level 3(ML-KEM-768 / ML-DSA-65)与 Level 5(ML-KEM-1024 / ML-DSA-87)两套参数皆已支持,全程采用恒定时间运算。

该实现尚不建议用于生产,但密码敏捷性是一项首要设计目标。当传统公钥密码学被攻破之时,InferNode 已经准备好了一条出路—并且原生运行在保护你智能体的同一套轻量级操作系统之上。

为什么是现在

三股趋势正在汇合。

InferNode 处于多种变革的交汇点上,这些变革使得安全、分布式的 AI 不仅成为可能—而是变得不可避免。

信任需要证明,而不是承诺。

随着 AI 智能体的自主性不断提高,“我们测试过了”已经不够。提示注入、混淆代理、权限提升—每授予一项能力,攻击面都会随之扩大。受监管行业开始要求形式化验证。InferNode 的隔离模型用 TLA+、SPIN 与 CBMC 证明完毕。数学就在那里,你只需要索取。

智能体需要一个安全的运行时。

所有主流平台都在抢着搭建多智能体系统—LangGraph、CrewAI、OpenAI Agents、AWS Strands,国内的通义、文心、智谱以及字节的扣子(Coze)也概莫能外。但它们全都让智能体在你的操作系统里、或在别人的云上,以环境权限运行。没人解决根本问题:如何让一个智能体真正干活,又不必把所有钥匙交到它手上?InferNode 的命名空间正是答案。

本地推理已成现实。

小型语言模型如今已能在本地硬件上处理大多数现实场景的查询,效率提升的速度令人吃惊。"有用的 AI 必须依赖云 API"这一假设不再成立—而当 AI 在本地运行时,你需要一个为它而设计的操作系统,而不是一个浏览器标签页。

关于资源占用: InferNode 基础运行时从约 15 MB 内存与 2 秒冷启动开始。真实负载—多个智能体、图形、大模型—会占用更多资源,任何系统都一样。重点不是它一直停留在 15 MB,而是它从这里出发,因此能跑在那些更厚重的运行时甚至无法启动的硬件上。

计算机即网络

你的设备。一个命名空间。无需云端。

每一种资源—GPU、传感器、LLM、数据库—都以文件呈现。从任何地方挂载它。你的 AI 智能体看到的是一个无缝统一的工作空间。

挂载任何东西

GPU 集群、本地 LLM、传感器数据流、云端 API—统统呈现为文件。一条命令:mount tcp!host!port /n/resource

智能体看到的是文件,不是 API

你的 AI 智能体读写文件即可。不需要 SDK、API key 或 OAuth token。只要资源被挂载,智能体就能使用它。

云是对等节点,而非主宰

想用云服务时就连接,不想用时就断开。你的命名空间两种状态都能正常工作。没有依赖,没有锁定。

分布式是与生俱来的

代码可移动。应用可延伸。无需重启。

在 InferNode 中,软件不是被"安装"—而是被挂载。应用程序不是“跑在某台机器上”—它跑在整个命名空间里。这些不是抽象概念,而是操作系统本身的工作方式。

通过网络热加载代码

开发者视角

在笔记本上编译一个模块,网络上的每台设备都能立刻加载并运行—无需重新部署、无需推送容器、无需部署流水线。改动一次,所有设备在下次加载时同步更新。

实际场景

把一个新的 ML 预处理过滤器推送到一整个边缘传感器队列。把一个安全补丁滚动到 mesh 网络的每个节点。给所有设备上的 AI 智能体增加一项新能力。全程零停机。

在那边运行,在这边查看。

开发者视角

应用程序通过 9P 把自己的接口导出为文件。把远程应用的命名空间挂载到本地,然后像本机应用一样与它交互。网络边界在操作系统层面消失了。

实际场景

让 LLM 推理跑在隔壁机房的 GPU 服务器上,在自己的笔记本上交互。在一台远程的强大机器上分析数据集,在野外的一台平板上看到结果。一个命名空间,硬件不再重要。

接口

一种协议,任意语言。

在 InferNode 内部,每一种资源都是文件—你用 open()、read()、write() 与 LLM、传感器和智能体打交道。从外部看,任何能讲 9P—一个简单、开放协议—的语言都能直接连接到 InferNode 并使用其中的资源。无需厂商 SDK,无需 API 包装层,只需一个文档完善的协议和你已经熟悉的语言。

写一个服务,它就是原生的。

用任意语言写一个服务,通过 9P 暴露出来,它就成了命名空间里的一个文件—与内置资源毫无差别。其他智能体、工具和用户都能立刻挂载并使用它。文件系统就是通用契约。

产品体系

一个安全的 OS,按你自己的方式使用。

InferNode 是基础—为每个智能体、在任意硬件上提供可证明隔离的命名空间。在它之上,选择最适合你工作方式的界面。或者,完全不用界面。

Veltro

自主智能体

Veltro 是一个驻留在命名空间中的 AI 智能体,而不是某个应用程序里的功能。它读取文件、调用工具、查询 LLM、派生子智能体—一切都在你定义的边界之内。无界面或交互式,由你选择。

/n/llm Lucia

语音优先的 AI 工作空间

Lucia 用对话式 AI 环境取代传统桌面。对你的电脑说话,智能体倾听、行动,并把结果—文档、数据、可视化—呈现给你,你完全不需要打开任何应用。可信赖的安全意味着可依赖的体验。

Xenith

开发者利器

一个为开发者与 AI 智能体并肩工作而打造的文本环境。从 Acme 派生,具备异步 I/O、暗色模式以及让智能体通过文件操作交互的 9P 接口—无需 SDK。智能体的每一步行动都可被实时观察。

Veltro

为自主工作而生。

一个驻留在命名空间中的 AI 智能体,而不是某个应用里的功能。每一项能力都是文件,每一道边界都是结构性的。

命名空间隔离

每个 Veltro 实例只能看到你挂载到其命名空间中的资源。没有环境权限,没有继承的凭据,没有攻击面。隔离不靠策略—而是结构性的。

子智能体

Veltro 可以派生具备其能力子集的子智能体。每个子智能体获得一个进一步受限的命名空间。授权而无提权—最小权限原则,递归地应用。

LLM 即文件系统

通过 llm9p 把任意语言模型挂载到 /n/llm。把 prompt 写入 /n/llm/0/ask,再把回复读出来。Claude、Ollama、任何后端—智能体看到的是文件,不是 API。更换提供商,无需改一行代码。

多设备

Veltro 可以跑在 Raspberry Pi、Jetson、笔记本或服务器上。通过 9P 把网络上任意设备的资源挂载到智能体的命名空间。智能体不知道也不在乎数据存在哪里—它就是能用。

应用场景

为那些不能寄望于

护栏能扛住的人而生。

智能体开发者

不必再担心智能体能访问什么。

当智能体与你共享操作系统时,构建自主智能体令人不安。InferNode 给每个智能体一个隔离的命名空间,只包含你授予的工具与数据。提示注入?智能体在自己的命名空间之外什么都看不到。攻击面根本不存在。

工业与关键基础设施

形式化验证,而不只是测试。

工厂车间、电网、水务系统—在这些环境里,失控的 AI 智能体不是麻烦,而是安全事故。InferNode 的隔离模型经过形式化验证。给审计人员展示数学,而不是承诺。

金融、法律与医疗

使用 AI,而不必把数据送到别处。

交易策略、客户档案、患者数据、法律证据—敏感程度无法接受放在别人的云上。InferNode 跑在你自己的硬件上,搭配本地 LLM。形式化验证的隔离意味着你可以向监管者和审计师证明封闭性,而不只是承诺。

边缘与嵌入式

15 MB,一块 35 美元的板子,真正的 AI。

在 Raspberry Pi 上跑 Kubernetes 是个糟糕的笑话。InferNode 在 15 MB 内存里运行,2 秒冷启动。在 Jetson、Raspberry Pi 或任何 ARM64/AMD64 设备上部署 AI 智能体—每个都在自己的隔离命名空间中。配合 JIT 编译,速度也很快。

关键任务运营

在云不可用的地方继续工作。

断网环境、艰苦条件、对抗性网络—在这些场景里,云 API 是负担而非便利。InferNode 完全运行在本地硬件上,设备之间以对等方式组成 mesh,即使上行链路中断仍然能继续工作。每个智能体始终被封闭其中。

分布式系统

让你的设备,如同一台机器协同工作。

从隔壁房间挂载一块 GPU,或者从国外挂载一块。InferNode 的 9P 协议让远程资源以本地文件的形式呈现。构建一个共享算力、存储与传感器的设备 mesh—每个节点都被隔离,整个系统则可组合。

快速开始

运行应用,或从源码构建。

在 macOS 上,下载即可运行。在 Linux 上,下载或从源码构建。无论哪种方式—一分钟以内即可完成。